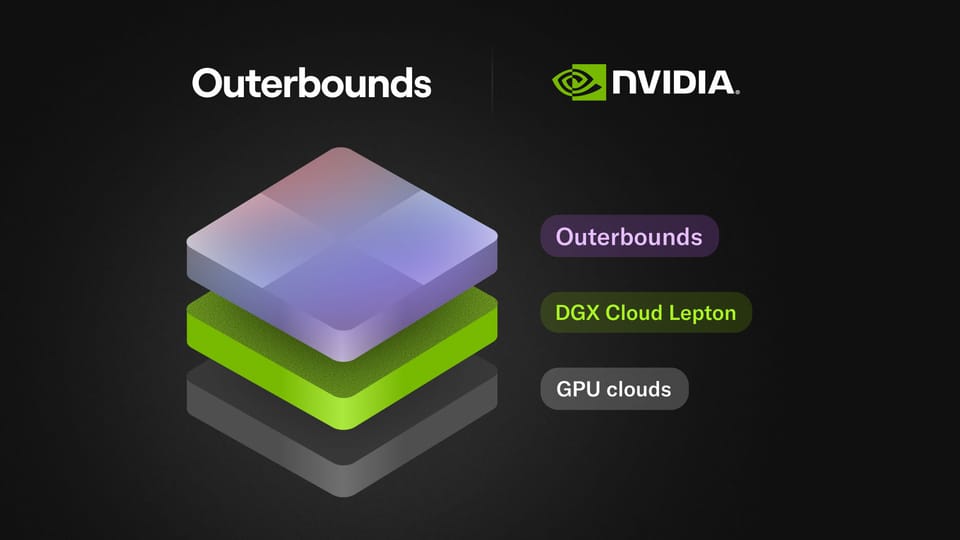

Outerbounds携手NVIDIA DGX Cloud Lepton,赋能企业自建差异化AI系统

现实世界中生产级别的AI系统涉及复杂的多组件协同。随着AI服务API日益商品化,企业构建差异化AI产品愈发依赖专有数据、精心设计的代码和微调模型。为满足此趋势,企业倾向于自主运营关键AI组件,以增强安全、隐私和合规性。Outerbounds平台正为此提供支持,它通过集成NVIDIA DGX Cloud Lepton,为企业提供一个统一接口,灵活访问多样化的GPU算力资源。

该平台基于开源Metaflow构建,旨在简化AI系统的开发与运营。它允许开发者在自有环境中构建、编排并持续优化AI产品。通过与NVIDIA DGX Cloud Lepton及NVIDIA Cloud Partner Nebius的深度集成,Outerbounds使用户能够便捷地接入最新的GPU技术,同时保持对现有基础设施、DevOps实践及安全策略的兼容性,大幅降低了引入新算力资源的门槛。

以一个Reddit帖子风格化与子版块推荐器为例,该应用展示了端到端的AI系统构建流程。系统利用Tens of thousands of vector indices和在线LLM组件,将用户提示转化为嵌入(embedding),匹配FAISS向量数据库,再由LLM重塑提示以适应目标子版块风格。整个流程,包括大规模向量索引的构建与更新,均可通过Outerbounds平台上的Metaflow工作流进行编排,并利用NVIDIA H100 GPU实现高效计算,显著提升了数据处理和模型推理的速度与成本效益。

Outerbounds平台整合了LLM、代理部署和批处理等AI系统核心要素,支持在线代理与离线工作流的统一管理。它通过Python API提供与NVIDIA NIM容器、GPU加速向量索引的无缝对接,使得复杂AI解决方案的构建如同调用现成API般便捷。其资产追踪能力,支持多版本并行部署与评估,为企业打造真正具备竞争力的AI产品提供了坚实基础。

网友讨论